En un movimiento que marca una línea clara entre la ética tecnológica y las ambiciones militares, la empresa de inteligencia artificial Anthropic ha rechazado formalmente las exigencias del Pentágono para eliminar sus salvaguardas de seguridad. La startup, reconocida mundialmente por ser la creadora del modelo de lenguaje 'Claude', se mantiene firme en su postura de no permitir que su tecnología sea empleada para la vigilancia doméstica masiva o el desarrollo de armas autónomas letales.

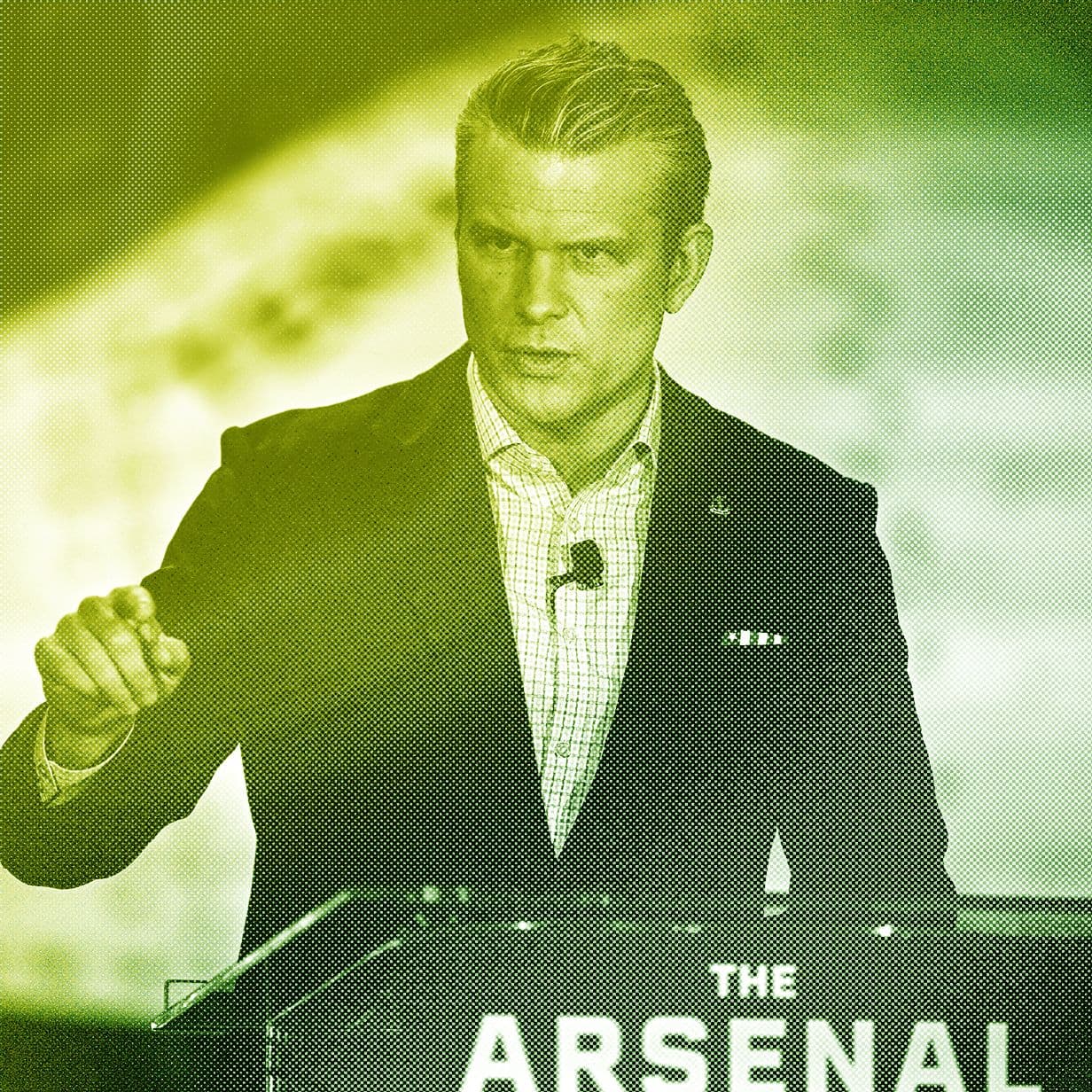

La controversia ha cobrado relevancia internacional tras las presiones ejercidas desde el entorno de Pete Hegseth, figura clave nominada para dirigir el Departamento de Defensa bajo la nueva administración estadounidense. Hegseth y otros altos mandos militares han abogado por una integración más agresiva de la inteligencia artificial en el arsenal de los Estados Unidos, sugiriendo que las restricciones éticas impuestas por las empresas de Silicon Valley podrían representar una desventaja estratégica frente a otras potencias.

Para el público mexicano, Anthropic es conocida por ser la competencia directa de firmas como OpenAI (creadora de ChatGPT). La empresa se distingue por su enfoque en la 'IA constitucional', una metodología que programa principios éticos directamente en el núcleo del software para prevenir resultados perjudiciales. La negativa de la empresa a ceder ante el Pentágono subraya una tensión creciente en la industria: la resistencia a que herramientas de innovación civil se conviertan en instrumentos de control gubernamental o en sistemas de combate que operen sin intervención humana.

El punto de fricción más delicado reside en la vigilancia masiva. El Pentágono busca utilizar la capacidad de procesamiento de datos de Anthropic para monitorear poblaciones a gran escala, una propuesta que la firma considera violatoria de los derechos de privacidad. Asimismo, la negativa a participar en el desarrollo de armas autónomas —capaces de seleccionar y atacar objetivos de forma independiente— responde a una preocupación global sobre los riesgos existenciales que estas tecnologías representan para la seguridad internacional.

Esta decisión de Anthropic sienta un precedente crucial en un momento en que México y otros países de la región debaten sobre los límites de la ciberseguridad y el uso de software de vigilancia por parte de las fuerzas armadas. La postura de la startup no solo protege su integridad corporativa, sino que también reabre la conversación sobre quién debe controlar el poder de la inteligencia artificial: los desarrolladores con principios éticos o las entidades militares con objetivos tácticos.